北京大学-腾讯协同创新实验室关于分布式机器学习体系Angel的研究取得紧张进展

日前,《国家科学评论》(National Science Review,NSR)在线发表了由北京大学信息科学技术学院、高可信软件技术教育部重点实验室崔斌教授课题组与腾讯数据平台部合作撰写的论文《一种新型大规模分布式机器学习体系Angel》(Angel: a new large-scale machine learning system,DOI: 10.1093/nsr/nwx018)。这是首篇刊登在NSR的信息科学领域研究论文。

文章回顾了学术界和工业界近期共同关注的机器学习体系,偏重介绍了Angel体系的设计思想和实现细节,并通过对多个大规模数据集上不同机器学习算法和体系的比较,验证了Angel体系在分布式机器学习方面的有用性。

现有的机器学习体系都是针对不同类型的机器学习义务而搭建的。数据流体系Hadoop和Spark适用于通用的数据处理义务和构建机器学习流水线,但缺乏参数共享机制,存在单点瓶颈性能题目;图计算体系GraphLab、GraphX和Tux2等将机器学习计算抽象成图结构,可行使图结构的特征加速,但只适合具有稀少图结构的算法;深度学习体系TensorFlow、MXNet和Caffe2等行使参数服务器或全局归约进行分布式神经网络的训练,可行使GPU对神经网络的计算加速,但缺乏对稀少图结构的优化和支撑。

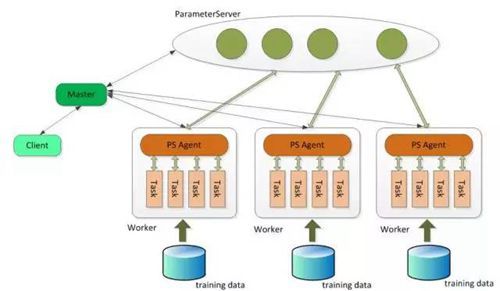

由北京大学-腾讯协同创新实验室开发的开源体系Angel(源代码见https://github.com/Tencent/angel)兼顾工业界的高可用性和学术界的创新性,集成和优化多种机器学习算法,是一个基于参数服务器理念的分布式机器学习框架,使机器学习算法在高维度模型上轻松运行。它围绕模型共享的核生理念,将高维度的大模型合理地切分到多个参数服务器节点,并通过高效的模型更新接口、运算函数和多变的同步协议实现各种高效的机器学习算法。得益于优秀的设计,Angel既能自力运行、高效实行多种机器学习算法,也能作为参数服务器服务,支撑Spark和现有深度学习框架,并为其加速。联合课题组基于工业界的海量数据,反复实践和调优,使得Angel具有广泛的适用性和稳固性,模型维度越高,上风越显明。经过在真实数据集上的对比,Angel在多种机器学习算法上的性能优于XGBoost、Spark、Petuum、TensorFlow等常用机器学习体系,已被应用于腾讯视频点击展望和广告保举等现实营业中。

Angel体系框架

Angel目前基于Java和Scala开发,将来还将加入Python等多种语言接口,使用更便捷,且参数服务器服务能力会进一步提拔,支撑图计算和深度学习框架。

编辑:山石

下一篇::深研院新材料学院在锂离子正极材料结构与性能研究取得紧张进展